一口气搞懂AI热词:从LLM到Agent,你不再当小白!

本文最后更新于:2026年3月1日 晚上

前言

是不是感觉全世界都在聊AI,但那些层出不穷的新词—— LLM、Prompt、Agent、RAG、MCP、Skills ——让你眼花缭乱,想加入讨论却不知从何说起?

别担心,这不是你的问题。清空大脑,忘记所有你听过或没听过的术语。接下来,我用一个完整的故事,把这些概念串成一条清晰的逻辑线,保证你看完就能懂。

一切,都从那个古老的起点开始。

那时的模型还是个“小玩具”,能力有限。但研究者们发现,当模型的参数规模(你可以简单理解为“脑容量”)突破某个临界点后,它突然就“开窍”了,表现出了令人惊讶的智能。这个原理我也说不明白,姑且称之为“大力出奇迹”吧。

为了和之前的“小玩具”区分开,我们给这些巨无霸模型起了个新名字:**Large language model**,简称是 **LLM**,中文名叫 **大语言模型**。

但LLM本质上只会做一件事:词语接龙。你给它一段话,它只负责预测下一个最可能出现的字是什么。如果只这么用,它看起来依然很白痴。

怎么让它变聪明?人类想了个巧妙的办法:角色扮演。

我们设定两个角色——“用户”和“助手”,把对话框成“一问一答”的格式输入给它。看,一个能进行基础对话的AI出现了!

此时的对话只能一轮,不能追问。而你的每一次提问,在AI领域有一个专属的酷炫名字:**Prompt**,中文叫 **提示词**。

记住,Prompt是整个AI应用最核心的概念,后面所有的进化,本质上都是在优化和丰富Prompt。

一段Prompt里,还可以做更精细的划分。比如,一部分是背景信息(“你是一位历史学家”),一部分是具体问题(“请分析法国大革命”)。这里的背景信息,就叫做 **Context**,中文名叫 **上下文**。

现在,我想在对话中追问怎么办?很简单,把刚才所有的对话历史,都作为新的Context背景信息,连同我的新问题,一起喂给LLM。

于是,这个只会词语接龙的模型,瞬间就拥有了 **memory(记忆**)的能力。

至此,原本只能进行词语接龙的大模型,就已经被优化成能对话、并不断追问的智能模型了。但人们还不满足,因为大家发现:LLM只知道它训练数据截止日期前的事。而世界新闻、最新股价,它一概不知。

这好办,给它“联网”不就行了?

很遗憾,不行。 我们反复强调,LLM只会词语接龙,它没有手,没有脚,没有任何执行能力。

于是,开发者们想了个“曲线救国”的办法:当LLM需要最新信息时,就让它“告诉”一个专门的工具A,由工具A去上网搜索,再把结果拿回来给LLM。这个能力,就叫 **Web Search**,中文名叫 **联网搜索**。

同理,除了上网,我们也可以让工具B去搜索本地的私人文件、公司资料库。只不过,需要先把普通的文本、表格,转换成LLM能更好理解的“向量”数据。这个过程,就是如今非常流行的外挂操作 **RAG**,中文名叫 **检索增强生成**。

可以对接的工具越来越多:查天气、读文件、运行脚本、分析PDF……为了管理这些五花八门的工具,不让LLM调用时出错,开发者们制定了一套标准的“沟通暗号”。这就是 **Function Calling**,中文名叫 **函数调用**。

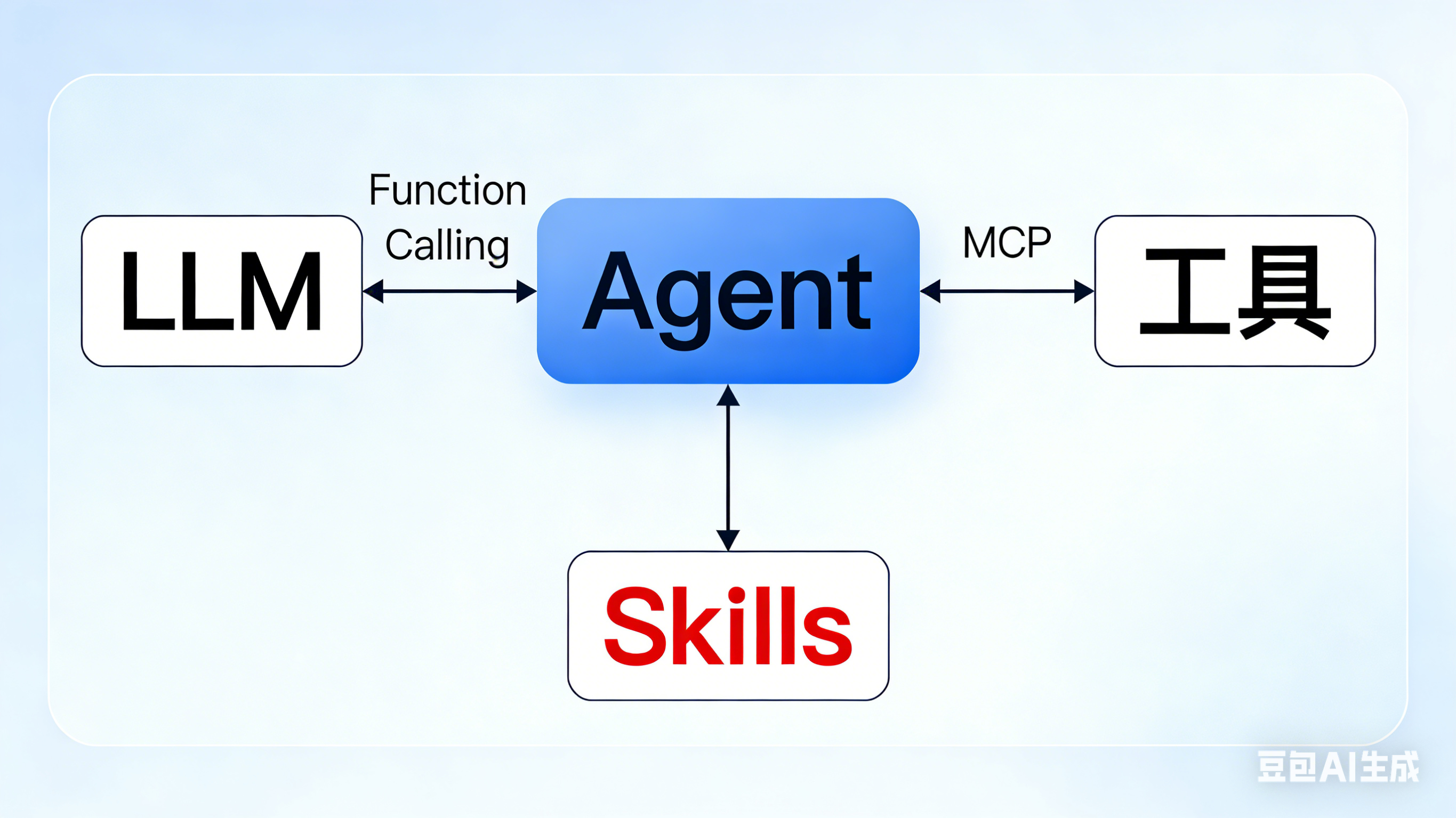

在用户看来,我只是在和AI对话。但AI背后,已经学会“暗中摇人”,调用各种工具来完成任务。此时,这个“LLM大脑 + 工具手”的组合体,看起来就无比智能了。我们给这个组合体起个名,叫 **Agent**,中文名叫 **智能体**。

但很快,Agent变得臃肿不堪。每个Agent都自带一堆工具,既不通用,也难维护。于是,聪明的开发者又把工具们“解耦”出来,变成独立的、可共享的服务模块。

那么,Agent如何发现和调用这些散落各处的工具呢?一套新的连接规范应运而生,这就是 **MCP**,中文名叫 **模型上下文协议**。

至此,架构清晰了:

- LLM是只会思考、说话的大脑。

- MCP服务是提供各种能力的手和脚。

- 中间的Agent,就是个超级调度员和传话筒,负责把大脑的指令和手脚的能力精准对接。

现在,我们聚焦在Agent和用户的交互界面上。虽然底层还是文字,但交互形式可以千变万化。

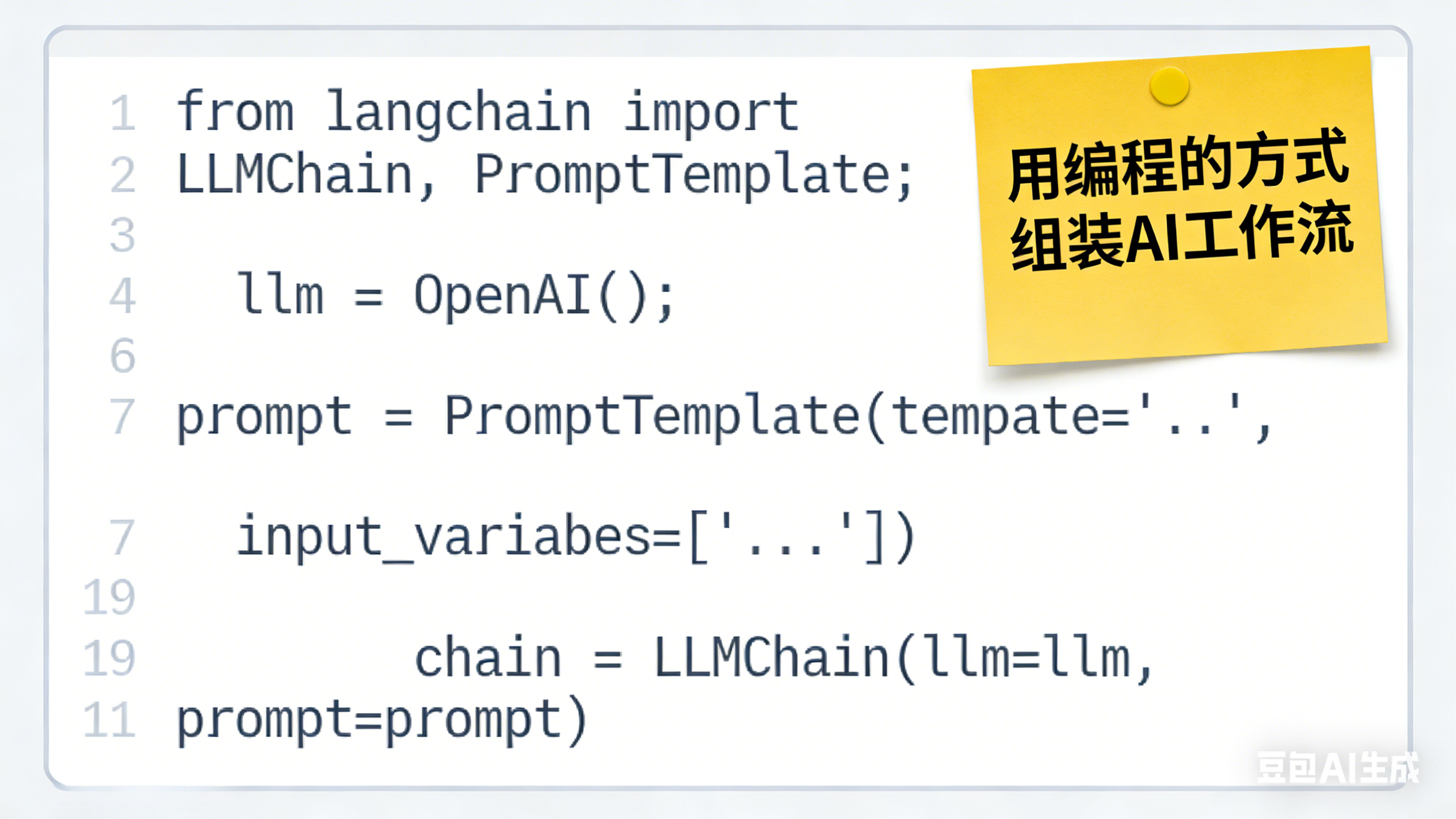

比如,程序员喜欢用代码来驱动Agent,于是有了 LangChain 这类框架。

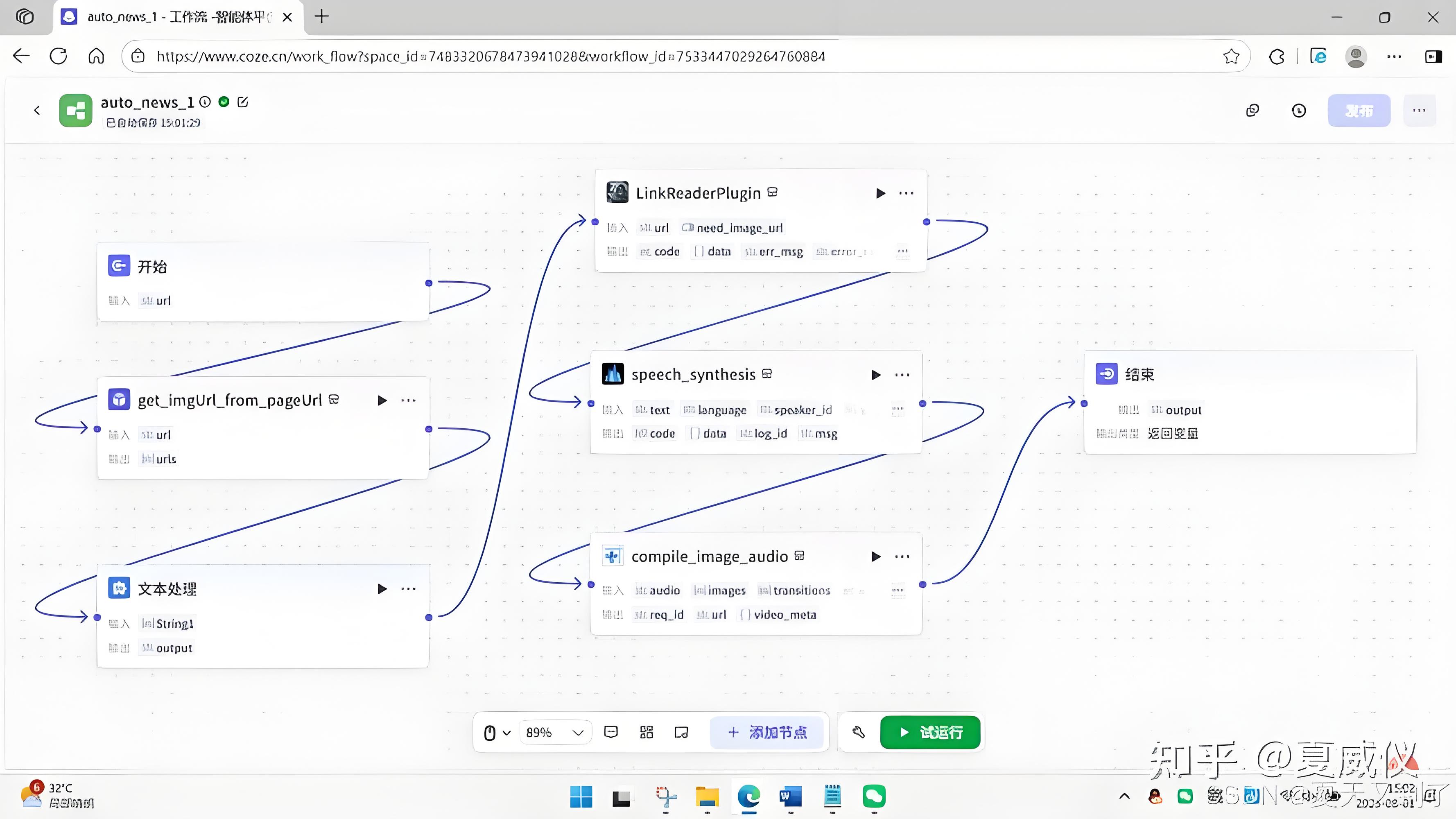

为了让非程序员等普通用户也能轻松玩转Agent,开发者又发明了 **Workflow**(中文叫 **工作流**),用拖拖拽拽的图形化方式,就能搭建一个AI工作流。

可是,如果任务极其复杂,涉及的工具和判断分支成百上千,难道要用代码写出所有的“if…else”,或者在Workflow里拖拽到天荒地老吗?

开发者们又想到了办法:把各种可能的工具调用脚本都写好,再写一份统一的“任务说明书”,告诉Agent整体目标和可用资源。执行任务前,先让Agent读透这份说明书,它就能自主规划步骤,灵活调用脚本。这套方法论,被尊称为 **Skills**,中文名叫 **技能**(虽然本质上,这就是给Agent预设一份超级详细的Prompt而已)。

总结与展望

让我们回顾一下这条进化之路:

词语接龙(LLM) -> 角色对话(Prompt)-> 拥有记忆(Memory)-> 调用工具(Function Calling)-> 智能体(Agent)-> 生态互联(MCP)-> 灵活交互(LangChain/Workflow)-> 复杂任务(Skills)

每一个新概念诞生时,都不乏夸张的鼓吹。但冷静看,它们的核心都是在用更工程化、更强大的方式去优化Prompt。

有人说这是“新瓶装旧酒”,但没有这些“新瓶”,就不会有后来琳琅满目的“美酒”。正是这些基石,才有了像Cursor、Trae这样改变编程的AI IDE,有了Dify、Coze这样强大的工作流平台,以及像OpenClow这样备受瞩目的桌面级智能体。

现在还有一个问题就是token太贵了。越智能的Agent,背后消耗的算力越大。但技术的趋势总是向下的,也许未来某天,AI的“思考”成本会像水电一样廉价。到那时,我们比拼的可能不再是“能否使用AI”,而是“能多高效、多巧妙地利用AI”。

更多编程教学请关注公众号:潘高陪你学编程

微信支付

支付宝